来源:美股财经社

万众瞩目的英伟达第四财季收益证明,黄仁勋赢得过分轻松。同时也向华尔街传递出一个信息:高速推进的人工智能火车头,目前还完全不存在减速的问题。

英伟达周三公布了其第四财季的收益,轻松超过了华尔街的预期。

黄仁勋表示:“企业对智能体的采用正在飞速增长。我们的客户正在竞相投资人工智能计算。”

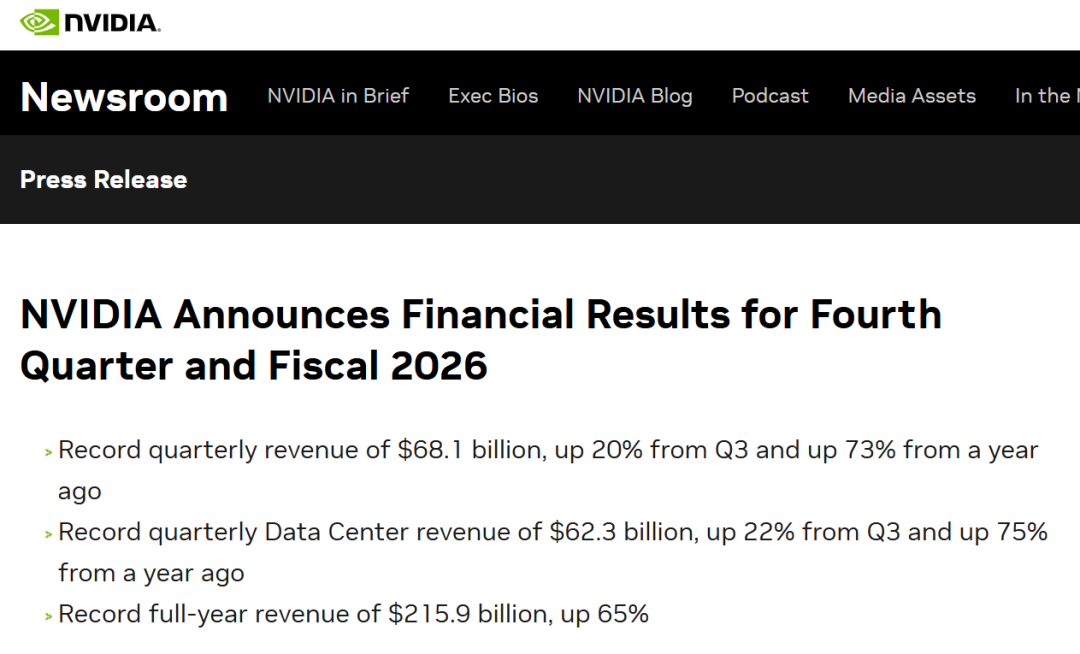

·英伟达公布的第四季度营收为681.3亿美元,高于此前预期的659.1亿美元,较第三季度增长20%,较去年同期增长73%。

·每股收益为1.62美元,也高于市场普遍预期的1.53美元。

·核心的数据中心业务部门,季度营收创历史新高,达623亿美元,较第三季度增长22%,较去年同期增长75%,也高于此前预期的603.6亿美元。

·全年营收也创出历史新高,达2159亿美元,同比增长65%。

展望未来,英伟达第一季度业绩也轻松超越分析师预期。预计营收将在764.4亿美元至795.6亿美元之间,远高于此前预估的727.8亿美元。

目前,正值人工智能交易的敏感时期。黄仁勋试图通过强调市场对人工智能计算的持续需求以及公司芯片产品群来安抚华尔街的紧张情绪。

英伟达首席财务官科莱特·克雷斯表示,公司已于本周早些时候向客户交付了“首批Vera Rubin芯片样品”。

在与分析师的电话会议上,黄仁勋表示:“现在,对我们的客户而言,推理能力就等同于收入,这一点至关重要。”他强调人工智能正处于“转折点”。

黄仁勋还介绍了英伟达与OpenAI的合作协议谈判的最新进展,称他认为谈判“接近”最终敲定。

当被问及太空数据中心的概念时,英伟达首席执行官表示,目前经济效益“很差”,但“随着时间的推移将会改善”。埃隆·马斯克对此正在大力投资。

周三,英伟达股价收涨1.41%,报195.56美元/股,总市值4.75万亿美元。之后,在财报发布后的盘后交易中上涨了约3%,但随着财报电话会议的进行,盘后涨幅快速回落,目前微涨0.20%。

在之后的CNBC采访中,黄仁勋表示,市场误判了人工智能对软件公司的威胁,反驳了人工智能代理会蚕食企业软件行业的担忧。

相反,他预计大批软件公司将使用AI智能体来开发软件并提高效率。

黄仁勋表示,人工智能代理不会取代这些软件工具,而是会反过来使用它们,这听起来“有悖常理”。

“这也是我们说代理人也是工具使用者的原因,”他补充道。

他提到了互联网浏览器和微软的Excel作为AI代理工具的例子。

“我们今天使用的所有这些工具,无论是Cadence还是其他工具。这些工具的存在自有其充分的理由。这些智能人工智能软件将代表我们使用这些工具,帮助我们提高工作效率,”黄仁勋补充道。

“最终,我们需要工具来完成他们的工作,并将信息以我们能够理解的方式呈现出来,”他说。

近几个月来,软件服务提供商的股价遭受重创。尽管分析师们警告称,人工智能将在长期内 “吞噬”软件行业,但对于这一风险以及近期抛售潮背后的基本面,各方看法不一。

黄仁勋发表讲话后,软件公司股价在盘后交易中涨跌互现。Synopsys股价收盘后下跌3.6%,Cadence下跌0.9%。ServiceNow股价基本持平,而SAP股价小幅上涨0.3%。

电话会要点

产品路线图与技术突破:近9吉瓦Blackwell基础设施已部署,性能比领先竞品50倍;已向客户发送首批Vera Rubin样品,预计2026下半年量产;将减少10倍推理token成本。通过软件优化(如CUDA),在四个月内将GB200 NVL72性能提升5倍。

战略合作与投资:与OpenAI接近达成伙伴协议;Meta部署数百万Blackwell和Rubin GPU;100亿美元投资Anthropic。收购Grok低延迟推理技术;与西门子、达索系统、新思科技深化工业AI合作

AI拐点已至:黄仁勋强调“代理AI”已达到拐点,算力将直接转化为收入。数据中心范式转变,每数据中心受电力限制,性能/瓦特成为关键指标。

物理AI崛起:2026财年已贡献超60亿美元收入;机器人出租车和自动驾驶将从千辆级扩展至百万辆级。

主权AI增长:2026财年主权AI业务超300亿美元,同比增长3倍,主要来自加拿大、法国、荷兰、新加坡和英国。

毛利率展望:预计全年保持在70%中段,依赖持续的架构创新提供多倍性能/瓦特提升。

未来展望:预计2027财年Q1收入780亿美元,数据中心驱动大部分增长;预计到2030年,全球数据中心资本支出将达到3-4万亿美元;已战略性确保库存和产能,满足需求到2027年;承认高端架构供应将持续紧张。

英伟达2026财年第四财季电话会议实录

公司参会人员 Colette Kress,执行副总裁兼首席财务官 Jensen Huang(黄仁勋),创始人、总裁兼首席执行官 Toshiya Hari,投资者关系与战略财务副总裁

其他参会人员(分析师) Aaron Rakers,富国银行 Antoine Chkaiban,New Street Research Atif Malik,花旗银行 Ben Reitzes,Melius Research CJ Muse,Cantor Fitzgerald & Co. Harlan Sur,摩根大通 Jim Schneider,高盛公司 Joseph Moore,摩根士丹利 Mark Lipacis,Evercore ISI Stacy Rasgon,伯恩斯坦研究公司 Tim Arcuri,瑞银集团 Vivek Arya,美银美林

会议陈述

接线员 下午好。我是莎拉,今天将担任您本次会议的接线员。此时,我想欢迎大家参加英伟达第四季度盈利电话会议。所有线路均已静音,以防止任何背景噪音。

发言人致辞后,将进行问答环节。(接线员提示) 谢谢。Toshiya Hari,您可以开始会议了。

Toshiya Hari 谢谢。 大家下午好,欢迎参加英伟达2026财年电话会议。今天与我一起代表英伟达参会的有总裁兼首席执行官黄仁勋(Jensen Huang),以及执行副总裁兼首席财务官科莱特·克雷斯(Colette Kress)。我们的会议正在英伟达投资者关系网站上进行实时网络直播。在讨论2027财年财务业绩的电话会议之前,本次网络直播将提供重播。

今天会议的内容是英伟达的财产。未经我们事先书面同意,不得复制或转录。在本次会议中,我们可能会根据当前的预期做出前瞻性陈述。这些陈述受到许多重大风险和不确定性的影响,我们的实际结果可能会有实质性差异。

关于可能影响我们未来财务业绩和业务的因素的讨论,请参阅今天收益发布中的披露内容、我们最新的10-K和10-Q表格,以及我们可能向美国证券交易委员会提交的8-K表格报告。我们所有的陈述都是基于截至今日(2026年2月25日)目前可获得的信息做出的。除法律要求外,我们不承担更新任何此类陈述的义务。在本次会议中,我们将讨论非公认会计准则(Non-GAAP)的财务指标。

您可以在我们网站上发布的CFO评论中,找到这些非公认会计准则财务指标与公认会计准则(GAAP)财务指标的调节表。接下来,我将把会议交给科莱特。

Colette Kress 谢谢,Toshiya。我们又交付了一个出色的季度,在营收、营业利润和自由现金流方面均创下历史新高。

总营收达到680亿美元,同比增长73%,较第三季度进一步加速。环比增长也创下纪录,我们的数据中心营收增加了110亿美元,客户群体日益多样化且不断扩大,包括云服务提供商、超大规模计算企业、AI模型制造商、企业和主权国家。我们在数据中心规模上进行极致协同设计的Blackwell架构需求持续增强,除了训练之外,推理部署也在不断增长。向加速计算的转型,以及AI在现有超大规模工作负载中的普及,继续推动着我们的增长。

建立在越来越智能和多模态模型基础上的代理式(Agentic)和物理AI应用,正开始推动我们的财务表现。从全年来看,数据中心创造了1940亿美元的营收,同比增长68%。自2023财年ChatGPT问世以来,我们的数据中心业务规模已经扩大了近13倍。展望未来,我们预计2026自然年内各季度的营收都将实现环比增长,超出我们去年分享的5000亿美元Blackwell和Rubin营收机会的预期。

我们相信,我们已经准备好库存和供应承诺来满足未来的需求,包括延续到2027自然年的出货量。每个数据中心都受到电力的限制。鉴于这些限制以及最大化AI工厂营收的需求,客户会基于每瓦性能做出关键的架构决策。SemiAnalysis近期宣布英伟达为“推理之王”,因为InferenceX的最新结果巩固了我们在推理领域的领导地位:与非网格(off-grid)方案相比,GB300和NVL72实现了高达50倍的每瓦性能提升,以及降低35倍的每Token成本。

对CUDA软件的持续优化,使得我们在短短四个月内就让GB200 NVL72的性能提升了高达5倍。英伟达提供了极低的每Token成本,而在英伟达上运行的数据中心能产生极高的营收。我们的创新步伐,尤其是在我们这样的规模下,是无与伦比的。凭借接近200亿美元的年度研发预算,以及我们在计算和网络、芯片、系统、算法和软件之间进行极致协同设计的能力,我们打算在每一代产品中都实现每瓦性能的X倍飞跃,并在长期内扩大我们的领导地位。

第四季度数据中心营收为620亿美元,同比增长75%,环比增长22%,这主要得益于Blackwell和Blackwell Ultra产能爬坡的持续强劲势头。由于对英伟达基础设施的高需求,即使是Hopper以及许多基于六年前Ampere架构的产品在云端也已售罄。自我们的Grace Blackwell NVL72系统发布以来,已经过去了近一年。如今,主要云服务提供商、超大规模计算企业、AI模型制造商和企业已部署并消耗了近9吉瓦(gigawatts)的基于Blackwell的基础设施。

网络业务是我们数据中心规模基础设施产品的基石,本季度表现突出,创造了110亿美元的营收,同比增长超过3.5倍。对我们向上扩展(scale-up)和向外扩展(scale-out)技术的需求达到了创纪录的水平,两者均实现了两位数的环比增长,这得益于NVLink、Spectrum-X以太网和InfiniBand的强劲采用。在同比基础上,增长主要由NVLink 72向上扩展交换机推动,因为Grace Blackwell系统约占该季度数据中心营收的三分之二。NVLink向上扩展架构彻底改变了计算,并展示了在超级计算机的所有芯片和全栈上进行极致协同设计的力量。

在第四季度,我们宣布将使AWS采用NVLink技术与其定制芯片进行集成。随着客户致力于将分布式数据中心统一为集成的千兆级AI工厂,我们的Spectrum-X以太网向上扩展和横向扩展网络势头强劲。从全年来看,我们的网络业务营收超过310亿美元,与我们收购Mellanox的2021财年相比增长了10倍以上。我们的需求情况广泛、多样,并正在向聊天机器人以外的领域扩展。

首先,发生了一场从传统机器学习向生成式AI的根本性平台转变。随着超大规模计算企业将海量的传统工作负载(包括搜索、广告生成和内容推荐系统)升级为生成式AI,强有力的投资回报率(ROI)证据正在鼓励我们最大的客户加快其资本支出。例如,在Meta,其生成式(Gen / Llama)模型的进步使其Facebook上的广告点击率增加了3.5%,Instagram上的转化率提高了1%以上,转化为有意义的营收增长。借助同样的英伟达基础设施,Meta的超级智能实验室可以训练和部署其前沿的代理式AI系统。前沿代理系统已达到一个拐点。

Claude Code、Claude Cowork以及OpenAI Codex已经实现了有用的智能。其采用率正在飙升,并且Token的生成是盈利的,这极大地推动了扩大计算规模的紧迫性。计算能力直接转化为智能和营收增长。分析师对排名前五的云服务提供商和超大规模计算企业(他们合计约占我们数据中心营收的50%多一点)2026年资本支出的预期,自年初以来已上调了近1200亿美元,正接近7000亿美元。

我们继续预计,传统数据中心工作负载向GPU加速计算的过渡,以及利用AI来增强当今超大规模工作负载的趋势,将贡献我们长期市场机遇的一半左右。每个国家都会建设和运营其部分AI基础设施,就像今天的电力和互联网一样。在2026财年,我们的主权AI业务同比增长了两倍多,超过300亿美元,主要由位于加拿大、法国、荷兰、新加坡和英国的客户推动。从长远来看,随着各国根据其GDP按比例在AI上进行支出,我们预计主权AI的机会至少将与AI基础设施市场的增长保持同步。

虽然美国政府批准了向中国客户提供少量H200产品,但我们尚未产生任何收入,并且我们不知道是否会允许任何进口进入中国。我们在中国的竞争对手在近期IPO的支持下取得了进展,从长远来看有潜力颠覆全球AI产业的结构。为了维持其在AI计算领域的领导地位,美国必须吸引每一位开发者,并成为所有商业企业(包括中国企业)的首选平台。我们将继续与美国和中国政府接触,并倡导美国在全球竞争的能力。

上个月我们在CES上推出了Rubin平台,包含六款新芯片:Vera CPU、Rubin GPU、NVLink 6交换机、ConnectX-9 SuperNIC、BlueField-4 DPU和Spectrum-6以太网交换机。与Blackwell相比,该平台能在使用四分之一GPU数量的情况下训练MOE模型,并将推理Token成本降低多达10倍。本周早些时候,我们已经向客户发运了首批Vera Rubin样品,我们有望在今年下半年开始量产出货。基于其模块化、无需理线(table-free/cable-free)的设计,Rubin将提供比Blackwell更好的弹性和可维护性。我们预计每个云模型构建者都将部署Vera Rubin。

接下来看游戏业务。游戏业务营收为37亿美元,同比增长47%,这得益于对Blackwell的强劲需求和供应的改善。GeForce RTX是PC游戏玩家、创作者和开发者的领先平台。在第四季度,我们增加了几项新技术和改进,包括使用AI将游戏视觉效果提升到新水平的DLSS 4.5,即使在运动中也能带来令人难以置信的清晰图形的G-SYNC Pulsar,以及在领先的AI PC框架中将大语言模型(LLM)推理速度提升35%。展望未来,尽管终端对我们产品的需求依然强劲,且渠道库存水平健康,但我们预计供应限制将成为第一季度及以后的阻力。

专业可视化业务营收首次突破10亿美元大关,达到13亿美元,同比增长159%,环比增长74%。在本季度,我们推出了配备72GB高速内存的RTX Pro 5000 Blackwell工作站,专为运行大语言模型(LLM)和代理式工作流的AI开发者设计。

汽车业务营收为6.04亿美元,同比增长6%,这得益于对自动驾驶解决方案的强劲需求。在CES上,我们推出了Alpamayo,这是世界上首个面向推理视觉语言动作模型、仿真蓝图和数据集的开放产品组合,赋予了车辆“思考”的能力。首款搭载基于英伟达Drive系统打造的Alpamayo的乘用车——新款梅赛德斯-奔驰CLA,即将上路。

物理AI已经到来,在2026财年已经为英伟达贡献了超过60亿美元的营收。无人驾驶出租车(Robotaxi)的出行量正在呈指数级增长,Waymo、特斯拉、优步(Uber)、文远知行(WeRide)和Zoox以及许多其他公司的商业车队预计将在下个十年内从2025年的数千辆扩大到数百万辆,创造一个有望产生数千亿美元营收的市场。这一扩张将要求计算量呈数量级增长,目前各大主要OEM和服务提供商都在英伟达的平台上进行开发。

我们通过新的NVIDIA Cosmos和Isaac Group、开放模型、框架以及英伟达驱动的机器人和自主机器,继续推进机器人技术的开发,合作伙伴包括波士顿动力(Boston Dynamics)、卡特彼勒(Caterpillar)、Franka Robotics、LG电子和Neuro Robotics等领先企业。为了加速工业物理AI的采用,我们还宣布与达索系统(Dassault Systèmes)、西门子和新思科技(Synopsys)达成新的扩展合作伙伴关系,将英伟达的AI基础设施、Omniverse数字孪生、世界模型和CUDA-X库带给数以百万计的研究人员、设计师和工程师,以构建世界工业体系。

让我们来看看损益表的其他部分。GAAP毛利率为75%,Non-GAAP毛利率为75.2%,随着Blackwell产能的持续爬坡,实现了环比增长。GAAP运营支出环比增长16%,Non-GAAP运营支出环比增长21%,这主要与新产品发布以及计算和基础设施成本有关。第四季度的Non-GAAP实际税率为15.4%,低于我们对该季度的预期,主要是由于一次性税收优惠的影响。

库存环比增长8%,同时由于我们战略性地锁定库存和产能以满足未来几个季度之外的需求,采购承诺也大幅增加。这比平时看得更远,反映了我们拥有的更长远的视线需求。虽然我们预计高级架构的供应紧张情况将持续存在,但凭借我们的规模、庞大的供应链以及长期合作伙持续为我们提供的良好服务,我们对抓住前方增长机会的能力充满信心。

我们在第四季度产生了350亿美元的自由现金流,在2026财年产生了970亿美元的自由现金流。在这一年中,我们以股票回购和分红的形式,向股东返还了410亿美元,占自由现金流的43%。我们将继续对技术和生态系统进行投资,以培育市场发展,推动长期增长,并最终产生优于市场或同行的总股东回报。重要的是,在投资方面,我们将继续执行战略性和纪律严明的流程,并继续致力于向股东返还资本。

现在让我谈谈第一季度的业绩展望。从本季度开始,我们将在Non-GAAP业绩中包含基于股票的薪酬支出(SBC)。股票薪酬是我们薪酬计划的基础组成部分,旨在吸引和留住世界级的人才。

首先看营收。总营收预计为780亿美元,上下浮动2%。我们预计大部分增长将由数据中心推动。与上季度一致,我们在展望中没有假设来自中国的任何数据中心计算营收。GAAP和Non-GAAP毛利率预计分别为74.9%和75%,上下浮动50个基点。对于全年,我们预计毛利率将保持在75%左右的中位水平。随着我们为Vera Rubin的过渡做准备,我们将随时向您通报最新进展。

GAAP和Non-GAAP运营支出预计分别约为77亿美元和75亿美元,其中包括19亿美元的股票薪酬支出。对于全年,我们预计Non-GAAP运营支出将同比增长40%左右(low 40s),因为我们将继续投资于不断扩大的机会领域。对于整个2027财年,排除任何离散项目和税务环境的重大变化,我们预计GAAP和Non-GAAP税率将在17%到19%之间。

接下来,我将把电话转交给黄仁勋,我想他有几句话要对我们说。

Jensen Huang(黄仁勋) 本季度,我们显著深化并扩大了与领先的前沿模型制造商的合作伙伴关系。最近我们庆祝了OpenAI发布的GPT 5.3 Codex,它是使用Grace Blackwell NVLink72系统进行训练和推理的。GPT 5.3 Codex可以承担涉及研究、工具使用和复杂执行的长期运行任务。5.3 Codex已在英伟达内部广泛部署,我们的工程师非常喜欢它。我们继续与OpenAI推进合作协议,并相信我们已接近达成。我们对与OpenAI正在进行的合作感到兴奋,这是一家十年难遇的公司,我们很荣幸从他们成立的第一天起就与之合作。

Meta超级智能实验室正在以闪电般的速度扩大规模。上周我们宣布,Meta正在部署数以百万计的Blackwell和Rubin GPU、英伟达CPU以及Spectrum-X以太网用于训练和推理。

本季度,我们宣布了与Anthropic的合作伙伴关系,并对其投资了100亿美元。Anthropic将在Grace Blackwell和Vera Rubin系统上进行训练和推理。Anthropic的Claude Cowork代理平台是革命性的,它打开了企业级AI采用的闸门。在Claude Cowork和OpenAI Codex的推动下,计算需求正在飙升,代理式AI的“ChatGPT时刻”已经到来。

凭借横跨Anthropic、Meta、OpenAI和xAI的合作关系,英伟达在每一朵云上的广泛部署,以及我们从头开始构建全栈AI基础设施或在云端为他们提供支持的能力,我们处于一个独特的地位,能够在前沿模型构建者的每个阶段(训练、推理和AI工厂的横向扩展)进行合作。

最后,我们最近与Grok签订了一项非独家许可协议,以获取其低延迟推理技术,并欢迎一个由杰出工程师组成的团队加入英伟达。就像我们之前对Mellanox所做的那样,我们将利用Grok的创新来扩展英伟达的架构,以实现AI基础设施性能和价值的新高度。我们期待在下个月的GTC大会上分享更多信息。

好的,交回给你们。我们现在进入问答环节。接线员,请接入问题。

问答环节

接线员 (操作提示)您的第一个问题来自美国银行证券(Bank of America Securities)的Vivek Arya。您的线路已接通。

Vivek Arya 感谢接受我的提问。我想你提到过,你们现在对2027自然年的增长也有了可见性,你们的采购承诺似乎也反映了这种信心。 但仁勋,我很好奇,当你看你们的顶级云客户时,今年云行业的资本支出接近7000亿美元,许多投资者担心明年很难在这个水平上继续增长,而且对他们中的一些人来说,现金流产生能力也受到压缩。我知道你对你们的产品路线图、采购承诺等方面非常有信心,但你对客户继续增加资本支出的能力有多大信心?如果他们的资本支出没有增长,英伟达还能在这个框架内找到增长点吗?谢谢。

Jensen Huang(黄仁勋) 我对他们现金流的增长充满信心,原因非常简单:我们现在已经看到了代理式AI(Agentic AI)的拐点,以及代理在世界各地和各类企业中的实用性。正因如此,你看到了令人难以置信的计算需求。

在这个AI的新世界里,计算即收入。没有计算,就没有办法生成Token;没有Token,就没有办法实现收入增长。因此,在这个AI的新时代,计算等于收入。我很确定,现在随着Codex和Claude Code投入生产使用,围绕Claude Cowork的兴奋感,加上对OpenAI系统及其企业版的热情,以及所有企业级ISV(独立软件开发商)目前都在其工具平台上构建代理式系统——我非常确定,此时我们正处于拐点。我们已经到达了这个转折点,我们正在生成能够为客户带来生产力、为云服务提供商带来利润的Token。

所以它的简单逻辑、也是简单的思考方式是:计算方式已经改变了。过去是软件运行在计算机上,使用适量的计算机,大概每年3000亿或4000亿美元的资本支出;现在这已经转向了AI。而在AI领域,为了生成Token,你需要计算能力,这直接转化为增长,直接转化为收入。

接线员 您的下一个问题来自摩根士丹利的Joseph Moore。您的线路已接通。

Joseph Moore 太棒了,谢谢。祝贺你们取得的业绩。 你谈到了你们对Anthropic以及潜在的对OpenAI核心进行的一些战略投资,同时你们也有英特尔、诺基亚、新思科技等合作伙伴,显然你们处于一切的中心。你能谈谈这些投资的作用吗?你如何看待资产负债表作为一种工具,以此来扩大英伟达在生态系统中的地位并参与到这种增长中去?

Jensen Huang(黄仁勋) 正如你所知,在英伟达一切的核心从根本上说就是我们的生态系统,这就是所有人喜欢我们业务的原因——我们生态系统的丰富性。世界上几乎所有的初创公司都在研究英伟达的生态系统,在英伟达的平台上进行开发。

我们遍布每一朵云,我们遍布每一个本地(on-prem)数据中心,我们遍布全球的边缘设备和机器人系统。成千上万的原生AI企业建立在英伟达之上。随着我们处于这个新的计算时代、这个新的计算平台转变的开端,我们希望抓住这个巨大的机会,让每个人都使用英伟达。每个人、所有东西都已经构建在CUDA之上。因此,我们从一个非常棒的起点出发。

随着我们构建整个AI生态系统——无论是针对语言的AI,还是物理AI、物理学AI、生物学AI、机器人技术或制造业AI——我们希望所有这些生态系统都构建在英伟达之上。对我们来说,这是在整个技术栈中投资生态系统的一个极好的机会。

我们今天的生态系统也比过去更加丰富。我们过去主要是一个基于GPU的计算平台,但现在我们是一家计算AI基础设施公司。我们在各个方面都有计算平台,从计算到AI模型,到网络,再到我们的DPU,所有这些之上都有计算栈。正如我之前提到的,无论是在企业中,还是在制造业、工业、科学或机器人领域,每一个生态系统都有不同的技术栈,我们希望确保继续对生态系统进行投资。因此,我们的投资非常明确、具有战略性地聚焦于扩大和深化我们的生态系统覆盖范围。

接线员 您的下一个问题来自摩根大通的Harlan Sur。您的线路已接通。

Harlan Sur 下午好,感谢接受我的提问。网络业务在你们整体数据中心业务中的占比继续上升。在2026财年中,你们网络业务的同比增速每个季度都在加快。正如你们提到的,第四季度同比增长3.6倍,显然得益于你们向上扩展(scale-up)和横向扩展(scale-out)网络产品组合的实力。

我记得去年上半年,你们在Spectrum-X以太网交换平台上的年化运行率(run rate)约为100亿美元。看起来去年下半年这个数字可能已经跃升至110亿到120亿美元左右。仁勋,看看你们的订单簿,特别是随着Spectrum-XGS以及即将推出的102T Spectrum 6交换平台的发布,目前Spectrum的运行率趋势如何?你如何看待今年结束时的情况?

Jensen Huang(黄仁勋) 正如你所知,我们将自己视为一家AI基础设施公司。AI计算基础设施包括CPU、GPU,而我们发明了NVLink,将单个计算节点“向上扩展(scale up)”成一个巨大的计算服务器机架。我们发明了机架级计算机的概念。我们交付的不是单个计算节点,而是整机架的计算机。

然后,这个NVLink交换机的向上扩展系统,会使用Spectrum-X和InfiniBand进行“横向扩展(scale out)”——这两种方式我们都支持。更进一步,我们还使用Spectrum-X进行跨数据中心的扩展。因此,我们思考网络的方式实际上是一种延伸,我们开放性地提供一切,以便人们可以决定如何在不同的规模下进行混合和匹配,或者按照他们希望的任何方式将其整合到他们定制的数据中心里。

但归根结底,这都是我们平台的巨大组成部分。NVLink的发明真正为我们的网络业务注入了涡轮动力。每个机架都配有九个网络交换节点,每个节点内部有两个芯片。在未来,它们会有更多。

所以,我们每个机架处理的交换量确实令人难以置信。我们现在也是全球最大的网络公司。如果你看看以太网领域,我们大约两年前进入了以太网交换市场。我认为我们今天很可能已经是世界上最大的以太网网络公司,肯定很快就会名副其实。

Spectrum-X以太网对我们来说是一个巨大成功。但我们对人们想要采用的任何网络方式持开放态度。有些人就是非常喜欢InfiniBand的低延迟和向上扩展能力,当然我们会继续支持这一点;而有些人喜欢基于以太网在整个数据中心整合他们的网络。我们创造了一种以太网功能,将以太网与数据中心处理人工智能的方式相结合,我们在这一点上做得非常出色。

我们的Spectrum-X性能确实证明了这一点。当建立一个100亿或200亿美元的AI工厂时,在数据中心网络效率和利用率上哪怕只有10%(很容易达到20%)的差异,这也将转化为实打实的真金白银。所以,英伟达的网络业务真的、真的增长得非常快。我认为这只是因为我们在构建AI基础设施方面非常有效,而且AI基础设施业务的增长快得惊人。

接线员 您的下一个问题来自Cantor Fitzgerald的CJ Muse。您的线路已接通。

CJ Muse 下午好。感谢接受提问。鉴于大上下文窗口应用、Grok以及可能需要添加特定解码解决方案的情况,我很好奇我们该如何看待你们未来的路线图。 我们是否应该预期,根据工作负载或特定客户进行定制化的芯片设计(Customized Silicon)将越来越成为英伟达的重点?特别是借助于你们向“裸片互连/Chiplet架构(die-to-die/dial-in)”的转变?非常感谢。

Jensen Huang(黄仁勋) 不,我们不这样认为。大家都应该希望尽可能地推迟使用裸片互连(die-to-die)。

原因在于,每次你跨越一个裸片互连接口,你都增加了一道接口。每次跨越接口,你就会不可避免地增加延迟,无谓地增加功耗。我们并不排斥裸片互连技术,实际上我们已经在使用了,但我们尽量只有在别无选择的情况下才使用它。所以,如果你看看Grace Blackwell架构和Rubin架构,我们使用的是两块达到光刻掩模极限(reticle-limited)的巨型芯片,并且将它们结合在一起,这样减少了架构跨越。

这种互连(接口)的损耗会在竞争对手的架构效能中显现出来。说到英伟达,人们常称之为我们的软件优势,但究竟哪里是软件的功劳,哪里是架构的功劳,其实很难区分。我们的软件之所以高效,是因为我们的架构太优秀了。

CUDA架构毫无疑问比市面上的任何计算架构都更有效、更高效,能提供更高的每瓦浮点运算性能,这是因为我们的架构设计方式。

关于我们如何看待Grok以及低延迟解码器,我有一些很棒的想法,希望能GTC大会上与你分享。但最简单的理念是:得益于CUDA,我们的基础设施具有令人难以置信的多功能性,我们将继续保持这一点,我们所有的GPU在架构上都是兼容的。这意味着,当我今天致力于为Blackwell优化模型时,所有这些针对优化软件栈和新模型所付出的努力和投入,也会使Hopper受益,也会使Ampere受益。这就是为什么在我们将其部署到世界各地数年后,A100依然感觉很新且性能依然出色的原因。

架构兼容性让我们做到了这一点。它让我们能够在软件工程和优化上投入巨资,因为我们知道,我们在云端、本地、以及任何地方运行的各代GPU架构的整个安装基数都将从中受益。

我们将继续这样做,它让我们能够延长产品的使用寿命,赋予我们创新的灵活性和速度。这一切为我们的客户转化为性能,并非常重要的是——转化为每美元性能和每瓦性能。所以,关于我们将与Grok做什么,你来GTC大会就知道了。但我们将做的是,用Grok作为加速器来扩展我们的架构,这与我们当年用Mellanox扩展英伟达架构的方式非常相似。

接线员 下一个问题来自伯恩斯坦研究公司(Bernstein Research)的Stacy Rasgon。您的线路已接通。

Stacy Rasgon 大家好,谢谢接受我的提问。Colette,我想深入探讨一下关于全年环比增长的预期。本季度你们数据中心业务环比增长了超过100亿美元,而业绩指引似乎暗示这种势头将继续。 随着我们经历这一年,尤其是当Rubin在这个间隔期内开始爬坡时,你如何看待这一趋势?Blackwell带来了非常大规模的环比增长加速,当我们过渡到Rubin时,我们是否应该期待类似的情况? 另外,我也希望你能谈谈对游戏业务的预期。我理解内存限制和其他一切问题。你认为游戏业务在2027财年仍能实现同比增长吗,还是因为内存问题将面临更大压力?请回答这两个问题。谢谢。

Colette Kress 谢谢,Stacy。让我先从未来的营收开始说起。我们试图逐个季度来看待营收情况。

当思考全年时,毫无疑问我们仍将销售和提供Blackwell,可能与此同时我们也看到Vera Rubin推向市场。这是一个非常棒的架构,能立刻帮助他们快速搭建系统。我们已经在多个不同客户中规划了许多不同的订单来提供这款产品。目前还无法确定Vera Rubin在下半年早期的爬坡能占多少比例,但毫无疑问,对其的需求和兴趣是非常强烈的。

我们预期几乎每个客户都会购买Vera Rubin。问题仅仅在于,我们推向市场的速度有多快,以及他们能在各自的数据中心里多快将其搭建起来。这是你的第一部分问题。

第二部分是关于我们的游戏业务。尽管我们非常希望能有更多的供应,但我们确实认为在接下来的几个季度里,供应将会非常紧张。如果到年底情况有所改善,那么从同比增长的角度来看还是有机会的。但目前我们判断还为时过早,一旦有了更明确的消息,我们会尽快回复你。

接线员 您的下一个问题来自花旗银行的Atif Malik。您的线路已接通。

Atif Malik 感谢接受我的提问。仁勋,我很好奇你是否可以谈谈,随着越来越多的AI投资流向推理工作负载,CUDA发挥的重要作用。

Jensen Huang(黄仁勋) 如果没有CUDA,我们在推理方面将不知所措。整个技术栈——从我们几年前推出的TensorRT LLM(这仍然是世界上性能最高的推理栈)开始——为了在NVLink上对其进行优化,我们需要发现并发明建立在CUDA之上的新并行化算法,以分配工作负载并进行推理,从而充分利用跨NVLink 72的聚合带宽。

NVLink 72使我们能够实现跨代级的、50倍的单位能耗性能提升。这是令人难以置信的领先优势,也是明智之举。NVLink 72是一项伟大的发明,实现起来非常困难。发明这种交换技术、将交换机解耦、构建系统机架等等,所有这一切我们都是在众目睽睽之下完成的,大家都知道这对我们来说有多难。但结果令人难以置信:每瓦性能提升了50倍,每美元性能提升了35倍。因此,推理能力的飞跃是极其惊人的。

非常重要的一点是,大家要认识到,现在对我们的客户来说,推理(Inference)就等于收入。因为智能代理(Agents)生成了如此多的Token,而且结果非常有效。当智能代理编写代码时,它会生成几千、几万甚至几十万个Token,因为它们会运行几分钟到几个小时。这些代理式系统会衍生出不同的代理作为团队协同工作。正在生成的Token数量真的、真的呈指数级增长。

所以我们需要以更快的速度进行推理。当你以更快的速度进行推理,并且这些Token中的每一个都以美元计价时,这就直接转化为收入。

因此,对我们的客户而言,推理性能就等于收入。对于数据中心来说,每瓦推理的Token数直接转化为云服务提供商(CSP)的收入。原因是每个人的电力都受限。无论你拥有多少数据中心,无论是100兆瓦还是1吉瓦,都有电力限制。所以,拥有最佳每瓦性能的架构就能转化为收益,因为每瓦能产出的Token数——也就是每个Token都被计价后——转化为每瓦的美元产出。在千兆瓦级别下,这直接决定了收入规模。

你可以看到,现在每一个CSP、每一个超大规模企业都明白这一点:资本支出转化为计算力。拥有正确架构的计算力意味着收入最大化,计算等于收入。如果现在不投资产能、不投资计算力,就不可能实现收入增长。我认为大家都明白这一点。选择正确的架构极其重要,这不仅仅具有战略意义,它直接影响他们的盈利能力,选择正确的架构——即拥有最佳每瓦性能的架构——真的意味着一切。

接线员 您的下一个问题来自Melius Research的Ben Reitzes。您的线路已接通。

Ben Reitzes 你好,谢谢。首先让我对你们在Non-GAAP业绩中包含股票薪酬的做法表示赞赏,我认为这是一个很棒的举措。但这并不是我的问题。

我的问题是关于毛利率及其在长期内维持在75%左右(mid-70s)的可持续性。供应可见性延伸到2027自然年,我们是否能从中解读出,在此之前这种毛利率是可持续的?另外,仁勋,那之后呢?你们是否能展示在内存消耗方面的创新,让我们对毛利率长期保持在这一水平的能力感到更加安心?谢谢。

Jensen Huang(黄仁勋) 影响我们毛利率最重要的一点,实际上是我们能否为客户交付代际的性能飞跃。这是最单一、也是最重要的事情。

如果我们能够实现每瓦性能的代际飞跃,远远超过摩尔定律的步伐;如果我们能够提供极高的每美元性能,远超我们系统的成本和定价,那么我们就能继续维持我们的毛利率。这是一个最简单、也是最重要的概念。

我们之所以发展如此之快,首先是因为世界经历了这几个拐点后对Token的需求已经完全呈指数级增长。我想我们都看到了这一点。以至于连我们部署在云端六年前的GPU都被完全消耗殆尽,而且定价还在上涨。所以我们知道,现代软件开发方式所需的计算量正呈指数级增长。

因此我们的战略是,每年交付一个完整的AI基础设施方案。今年,我们引入了六款新芯片(Rubin平台),下一代我们也会推出许多新芯片。每一代产品,我们都致力于提供X倍的每瓦性能和每美元性能飞跃。这种步伐,加上我们进行极致协同设计的能力,使我们能够将这种价值和收益传递给客户。只要这关乎我们交付的价值,这就是最至关重要的事情。

接线员 您的下一个问题来自New Street Research的Antoine Chkaiban。您的线路已接通。

Antoine Chkaiban 你好,非常感谢接受提问。我想问关于“太空数据中心”的问题,你们的一些客户正在考虑这个想法。 你认为它的可行性有多高?时间表是怎样的?现在的经济效益如何?你认为这会随着时间如何演变?谢谢。

Jensen Huang(黄仁勋) 嗯,今天的经济效益还很差,但这会随着时间的推移而改善。正如你所知,太空中的工作方式与地球上截然不同。太空中有丰富的能源,需要巨大的太阳能电池板,但在太空中有着充足的空间。

在散热方面,太空确实很冷,但是没有空气流动。所以唯一能散热的方式就是通过传导。你需要制造的散热器尺寸相当大。液冷显然是不可能的,因为它很重而且会结冰。所以我们在地球上使用的方法与在太空中采用的方法会有所不同。但有许多不同的计算问题,确实很适合在太空中进行处理。

所以,英伟达已经有了世界上首个太空GPU,Hopper目前就在太空中。GPU在太空中最好的用例之一是成像。在太空中,利用光学技术和人工智能,能够以极高的分辨率进行成像,能够进行不同角度投影的计算,能够提高分辨率并进行降噪,拥有能在极高分辨率和极大尺度下进行快速成像的视觉能力。要在地球上通过传输数PB(petabytes)的成像数据来完成这项工作是很困难的。直接在太空中处理会更容易。

你可以忽略所有收集到的并在处理中发现无用的数据,直到你看到有趣的东西再回传。因此,人工智能在太空中将会有非常出色、非常有趣的应用。

接线员 您的下一个问题来自Evercore ISI的Mark Lipacis。您的线路已接通。

Mark Lipacis 你好,感谢接受我的提问。我想继续探讨关于在简报中提到的收入多元化的问题。我相信Colette你提到过,超大规模计算企业占了你们收入的50%以上,但业务增长却是由其余的数据中心客户主导的。我只是想澄清一下,确保我理解对了。

这是否意味着非超大规模客户的增速更快?如果是这样,你能否帮助我们理解一下,非超大规模客户在做些什么不同的事情?他们是在做与超大规模客户不同的事情,还是在不同规模下做同样的事情?你是否认为这种趋势会持续下去?你是否预计你们的客户群会演变到某个阶段,使得非超大规模客户成为你们业务的更大组成部分?谢谢。

Colette Kress 好的,看看我们能否解答这个问题。当你想到我们提到的前五大CSP(云服务提供商)和超大规模计算企业时,他们目前约占我们总收入的50%。但在除此之外,还有各种类型的公司组织形式,具有极强的多样性,这涵盖了AI模型构建商、企业用户、超级计算机构以及我们的主权AI客户。此外还有很多其他不同的领域。你说的没错。

这也是一个增长非常快的领域。我们不仅在所有各种云提供商平台上占据强势地位,而且现在也在世界各地看到了极端多样化的客户群体。能够看到这种多样性并有能力服务于所有这些不同的群体,将极大地使我们受益。看看仁勋是否想再补充一点。

Jensen Huang(黄仁勋) 是的,这是我们的生态系统建立在CUDA之上所拥有的优势之一。

我们是唯一一个进驻每一朵云的加速计算平台,可以通过每一个计算机制造商获得,并且在边缘侧可用。我们现在还在培育电信领域。很显然,未来的无线电都将是由AI驱动的无线电,未来的无线网络也将是一个计算平台。这是不言而喻的定论,但总得有人去发明相关的技术来实现它。我们创建了一个名为Aerial的平台来做这件事。我们的技术搭载在几乎每一个机器人、每一辆自动驾驶汽车中。CUDA能够兼顾一方面通过GPU内的Tensor Core实现专用处理器的性能优势,另一方面又具备极强的灵活性,这使我们能够解决从语言问题、计算机视觉问题、机器人问题,到生物学问题、物理问题以及几乎所有种类的AI和计算算法问题。

因此,客户群的多样性是我们拥有的最大优势之一。第二点当然是,如果没有我们自己的生态系统,即使我们的处理器是可编程的,如果我们不培育生态系统(就像我们今天谈论投资未来生态系统并继续强化生态系统那样),我们很难突破仅仅在别人的生态系统中赢得几个设计订单(design wins)的局限。由于我们创建的这个平台,我们可以非常自然地增长并扩大我们的生态系统。

最后非常重要的一点是,我们与OpenAI、Anthropic、XAI和Meta建立的合作伙伴关系。当然,还有世界上几乎所有的开源项目。Hugging Face上有150万个AI模型。所有这些都在英伟达CUDA上运行。如果把所有的开源模型加起来,可能代表着世界上第二大的模型集合(OpenAI是最大的,所有开源的集合可能是第二大的)。英伟达能够运行所有这一切,使得我们的平台具有极强的可替代性(fungible)、极其易用,并且值得放心投资。这创造了客户的多样性和平台的多样性,并且因为我们支持全球的生态系统,所以能够在每个国家/地区使用。

接线员 您的下一个问题来自富国银行的Aaron Rakers。您的线路已接通。

Aaron Rakers 你好,感谢接受提问。我想顺着平台和极致协同设计的理念问一下。过去一个季度里的一些新闻指出,英伟达有能力或正在推动将Vera CPU作为独立的解决方案推向市场。仁勋,我很好奇,在我们向前发展的过程中,Vera在架构演进中扮演了什么重要的角色?这是由推理工作负载的激增或异构性所驱动的吗?我很好奇你如何看待它对于英伟达的发展,尤其是基于独立CPU的形式。谢谢。

Jensen Huang(黄仁勋) 是的,谢谢提问。我会在GTC大会上告诉你更多细节。但从最高层面上讲,我们在CPU架构上做出了与世界上其他CPU截然不同的根本性决策。它是唯一一款支持LPDDR5的数据中心CPU。它的设计初衷是专注于极高的数据处理能力。

原因在于,我们感兴趣的大多数计算问题都是数据驱动的,人工智能就是其中之一。而Vera的单线程性能与带宽的比例非常出色。我们做出这些架构决策,是因为在AI的整个流水线和不同阶段(在进行训练之前,你必须进行数据处理),涵盖了数据处理、预训练,以及现在的后训练阶段。现在AI正在学习如何使用工具。

而许多工具的使用环境是在仅有CPU的环境中运行,或者在CPU与GPU加速相结合的环境中运行。Vera的设计旨在成为一款用于后训练阶段的卓越CPU。因此,在人工智能整个流水线中的一些用例,包括了使用大量的CPU。我们既喜欢GPU,也同样喜欢CPU。

当你像我们一样将算法加速到极限时,阿姆达尔定律(Amdahl's Law)表明,你需要非常非常快的单线程CPU。这就是为什么我们把Grace架构构建得在单线程性能上极其出色的原因,而Vera的性能比那还要好得出奇。

接线员 您的下一个问题来自瑞银集团的Tim Arcuri。您的线路已接通。

Tim Arcuri 非常感谢。 Colette,我想知道你能否谈谈关于资本部署的问题。我知道你们大幅提高了采购承诺规模,听起来你们可能已经度过了投资高峰期,而且今年你们可能会产生大约1000亿美元的现金。然而,不管业绩有多好,股价似乎并没有涨太多。所以我认为你们可能会觉得目前的价位是回购大量股票的一个相当不错的价格。

我想知道你能否谈谈这个。问题是,为什么不立下一个重大目标,在这里进行一次大规模的股票回购呢?谢谢。

Colette Kress 谢谢你的提问。我们非常谨慎地审视我们的资本返还计划。我们确信,我们能做的最重要的事情之一,就是真正支持摆在我们面前的宏大生态系统。这涵盖了方方面面:从我们的供应商,到为确保供应链安全并帮助他们提升产能我们所需做的工作,一直延伸到在我们平台上开发AI解决方案的早期开发者。

因此,我们将继续把这(投资生态)作为我们流程和战略投资中非常重要的一部分。当然,我们也仍在回购我们的股票。我们也在继续发放股息。我们将继续在这一年中寻找合适的特定机会来进行这些回购。

接线员 您的最后一个问题来自高盛公司的Jim Schneider。您的线路已接通。

Jim Schneider 感谢接受我的提问。仁勋,你之前曾概述过,到2030年数据中心资本支出有可能达到3万亿到4万亿美元,这意味着增长率可能会加速,你也在接下来的季度指引中暗示了这一点。 我的问题是,你认为最有可能驱动这种拐点的关键应用有哪些?是物理AI、代理式AI还是其他什么?你仍然对3万亿到4万亿美元的市场预期感觉良好吗?谢谢。

Jensen Huang(黄仁勋) 是的,让我们退一步,从几个不同的角度来推理一下。

首先,从第一性原理来看。未来开发软件的方式是利用AI驱动的软件。使用AI是由Token驱动的。我想大家都在谈论代币经济学(Tokenomics),谈论数据中心生成Token,推理的本质就是生成Token。我们在生成Token,刚才还谈到了英伟达的NVLink72如何使我们在单位能耗上以比上一代高出50倍的性能来生成Token。因此,在未来,Token生成几乎处于所有与软件和计算相关事务的中心位置。

回顾我们过去使用计算的方式,过去软件所需的计算量,仅仅是未来所需的一小部分。AI已经来了,且不会倒退,AI只会变得越来越好。所以,如果你想一下,过去世界每年在经典计算上的投资大约是3000亿到4000亿美元。而现在AI到来了,所需的计算量比我们过去计算方式所需要的要高出一千倍。计算需求就是高出很多很多。只要我们继续相信这其中有价值(我们稍后会谈到这一点),世界就会投资于计算能力来生产这些Token。因此,世界所需的Token生成能力,远远不仅是7000亿美元所能涵盖的。

我相当有信心,从现在起,我们将继续生成Token,我们将继续投资计算能力。因为从根本上说,每家公司都依赖软件,每个软件都将依赖AI。因此,每家公司都会生产Token。这就是我称它们为“AI工厂”的原因。如果你的公司身处云数据中心,你拥有AI工厂为你的收入生成Token;如果你是一家企业级软件公司,你将为你工具上的代理式系统生成Token;如果你是一家机器人制造商(自动驾驶汽车就是其最初的表现形式),你将拥有巨大的超级计算机(本质上就是AI工厂)来生成输入到你汽车中的Token,成为它的AI大脑。然后你还必须把计算机放在汽车里,持续不断地生成Token。

所以,我们现在非常确定这就是计算的未来。

那么,为什么我们如此确定这就是计算的未来呢?原因在于我们过去制作软件的方式是预先录制的。所有的东西都是先验捕捉好的。我们预编译软件,预先编写内容,预先录制视频。但现在,一切都是实时生成的。当它实时生成时,它可以将人的背景、所处的场景、查询的内容以及意图都考虑在内,以生成这种被称为AI(或代理式AI)的新型软件的结果。因此,它所需的计算量远远、远远大于预先录制好的。正如计算机拥有比预先录制内容的DVD播放器多得多的计算能力一样,人工智能需要的计算能力也远大于我们过去做软件的方式。

关于计算可持续性的问题,首先在计算机科学层面,这就将是未来计算的方式。

其次在产业层面。归根结底,所有公司都由软件驱动,云服务公司由软件驱动;如果新软件需要生成Token,且这些Token是可以变现的,那么顺理成章地,他们数据中心的建设将直接驱动他们的营收。计算驱动营收,我想他们都明白这一点,我认为外界也越来越多地开始明白这一点了。

最后,AI为世界创造的效益最终必须能转化为收入。我们正亲眼看着它发展,正如我们现在所处的阶段,代理式AI已经到了一个拐点。这实际上就发生在过去的两三个月里。当然,在行业内部,我们看到这个趋势有一段时间了,大概有六个月左右,但现在整个世界都已经觉醒,意识到了代理式AI的拐点。代理(Agents)超级聪明,它们正在解决实际问题。编程工作显然现在是由代理式系统辅助的,我们英伟达内部所有的程序员都在大量使用代理式系统,无论是Claude Code、OpenAI Codex,还是Cursor,经常取决于用例而三者并用。但他们拥有了代理和协同设计的工程伙伴来帮助他们解决问题。

你可以看到这几家公司的营收在飙升。以Anthropic为例,我认为他们的营收在一年内增长了10倍,而且他们严重受限于产能,因为需求实在是令人难以置信。对Token的需求令人难以置信,Token生成率呈指数级增长。OpenAI也是一样,他们的需求非常惊人。因此,他们能建立并上线的计算能力越多,他们的收入增长得就越快。

这又回到了我之前的观点:推理就是收入,在这个新世界里,计算等于收入。从很多方面来看,这就是为什么我们说这是一场新的工业革命。

新的工厂、新的基础设施正在建设中,这种新的计算方式不会倒退。因此,只要我们相信生成Token将是计算的未来——我坚信这一点,我认为整个行业也大抵相信这一点——那么从现在起我们将继续建设这种能力,并从这里继续扩张。

目前我们正在经历的浪潮是代理式AI的爆发;而在此之后的下一个拐点,是将物理AI以及这些代理系统引入物理应用中,比如制造业,比如机器人技术。所以,前方存在着巨大的机会。

接线员 问答环节到此结束。我将把会议交给Toshiya Hari。

Toshiya Hari 在会议结束之际,请注意,黄仁勋将于3月4日在旧金山参加摩根士丹利TMT(科技、媒体及电信)会议的炉边谈话。他还将于3月16日在圣何塞的GTC大会上发表主题演讲。我们讨论2027财年第一季度业绩的电话会议定于5月20日举行。感谢大家今天的参与。 接线员,请结束会议。

接线员 谢谢。今天的电话会议到此结束。您现在可以挂断了。会议已结束。